1) Was ist bei einem für SEO optimierten Text wichtig?

Häufig wird von Keyword-Density (Keyword-Dichte) gesprochen, wobei darauf zu achten ist das kein Keyword-SPAM entsteht welcher schlimmstenfalls zu einem Google-Penalty (Abstrafung durch Google) führt. Praxis-Tests haben gezeigt, dass lange Texte besser im Ranking positioniert werden, also kurz optimierte Texte. Google legt immer mehr Wert auf guten und viel Content, umso mehr, umso besser. Ca. 100 Wörter ist eine gute Richtlinie, auch weil viele Webseiten-Besucher Texte über diese Länge meiden bzw. zu Ende lesen. Bei kürzeren Texten kommt meist der Informationsgehalt zu kurz.

Keyword-Density ist unwichtig! Ein Keyword am Anfang, in der Mitte und zum Ende des Textes reichen völlig in der Größenordnung von ca. 100 Wörtern.

Wichtiger ist dagegen an Neben-Keywords zu denken. Ein Keyword-Optimizer kann helfen ähnliche Wörter/Kombinationen oderKombinationen finden, wichtig vor allem um besseren Longtail zu erhalten.

2) Welcher Mehrwert haben Bilder, Videos oder optimierte Listen?

Durch Bilder wird die Seite auf, des weiteren wird die Seite bzw. die Bilder in der Google-Bildersuche gefunden, wodurch der Besucherstrom/Webseitenreichweite verbessert wird und Schluss endlich der Longtail optimiert.

Videos sind gut um die Verweildauer zu verlängern.

Eine Strukturierte Webseite mit Zwischenüberschriften und Listen kann durch Google besser indexiert werden, hinzu kommt das eine semantisch gute Webseite (Stichwort: Web 3.0) besser für jegliche Maschinen, Clients, etc. gelesen werden kann.

3) Welche Meta-Angaben sind wichtig?

Das Meta-Tag „Description“ kann die Klickrate bei Google verbessern.

Die Sprach- und Länderangaben können sehr nützlich sein, auch weil Google das Ranking von dem Standort des Suchmaschinen-Benutzers abhängig macht.

Tags die „noodp“ (besagt dass der Beschreibungs-Text nicht aus dem Open Directory Project übernehmen werden soll) und anderte, kann verzichtet werden.

4) Welche Meta-Angaben sind denn wirklich wichtig?

Das Meta-Tag „Description“ ist für die Durchklickrate bei Google wichtig.

Auch Sprach- und Länderangaben können sehr nützlich sein.

Auf „noodp“ (= nicht den Text aus dem Open Directory Project übernehmen) und den meisten anderen Kram können wir verzichten.

Zu erst sollt man analysieren welche Seiten „wichtig“ und welche „unwichtig“ sind!

Unwichtige Seiten sind z.B. Fehler-Seiten (404 Error Page), Leere Ergebnisseiten aus Filterfunktionen, paginierte Kategorieseiten (Duplicate Content vermeiden), etc.

Allg. kann man sagen, alle Seiten welche kein Mehrwert für den Besucher bringen.

Die einfachste Möglichkeit Google zu sagen, dass diese Webseiten nicht indexiert werden soll ist den „noindex“ Tag auf der Seite zu setzen. Bei Übersichtsseiten (Listen) sollte ein „follow“ dahinter gesetzt werden, wenn eine Indexierung der verlinkten Seiten erwünscht ist.

Ebenfals nützlich ist das Cononical-Tag, auch um für Google bei Duplicate Content die Ursprungsseite zu markieren.

5) Welche sind die häufigsten Einsteiger-Fehler im Bereich SEO?

Die Verwendung falscher Keywörter ohne Abgleich nach dem Suchvolumen. Selbst eine Keywort optimierte Seite bringt keine Besucher, wenn niemand danach sucht.

Zu glauben, dass man mit einer beliebigen Firmenwebseite mit einem heiß umkämpften Keyword (z.B. „Arzt“), ohne weiteres auf Platz 1 landen kann. Wichtig wäre dagegen mehr auf Suchphrasen zu optimieren.

Die Verwendung unnötiger oder veralteter Tags, z.B. das Meta-Keyword-Tag wird nicht mehr von den Suchmaschinen verwendet, muss deshalb auch nicht gesetzt sein. Viele Einsteiger setzen hingegen dies gar manuell, einfach verschwendete Zeit.

6) Welche Fehler machen erfahrene SEOs am häufigsten?

Zu lange Inhalte mit falscher Keyword-Density von z.B. 10 Prozent, danach Penalty durch Google oder gar Ausschluss aus dem Index.

Weiterbildung, selbst wenn vor 2-3 Jahren ein Projekt mit diversen Praktiken/Tricks gut gerankt hat, so muss dies heute nicht mehr gelten. Google verändert nahezu täglich ihren Algo und die Gewichtung der Einfluss-Faktoren. Z.B. Social-Media war vor 2 Jahren kaum ein wichtiger Ranking-Faktor, aktuell hat Google den Social-Graph geschaffen und eine Webseite welche gut im Social-Media-Umfeld vernetzt ist deren Wert steigt bei Google und damit ebenfalls das Ranking.

Die Optimierung sollte jeweils passend zur Seite sein, die Methoden zur Optimierung sind bei einem Webshiop anders als bei einem Portal, einer Community oder Affiliate-/Landing-Page.

Projekte nicht regelmäßig beobachten und Erfolge auswerten. Gerade aufgrund des sich regelmäßig sich ändernden Algorhytmus und die Gewichtung der Einflussfaktoren, sollte eine Webseite in regelmäßigen Abständen (mind. alle 1/2 Jahre) neu auf die aktuelle SEO & Social-Media-Optimierung analysiert werden.

Schauen was die anderen Webseiten so machen. Gerade wenn es um Werbeeinnahmen, Besuchertreue oder Konversion-Optimierung geht, ist Verweildauer ein wichtiges Thema. Vielleicht wird dieser Faktor gar in der Zukunft ein wichtiges Ranking-Kriterium? Eine kurze Verweildauer spiegelt auch den Wert der Webseite wieder, maßnahmen zur Verlängerung sollten umgesetzt, zu minntest diskutiert werden.

7) Welche Tipps und Trends im Bereich Onsite gibt es für das SEO Jahr 2011?

HTML5

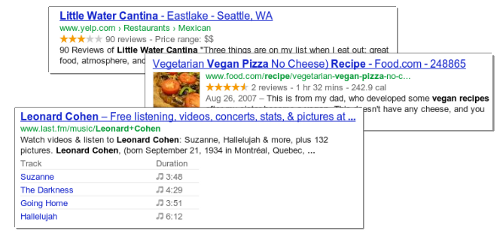

Rich Snippets für Bewertungen, Kommentare und viele andere Informationen.

Integration in Social-Media – Google lässt die Besucher entscheiden welche Webseite wertvoll ist. Umso mehr „Likes“, Tweeds, Verlinkungen, etc. umso höher der Wert des Artikels oder der Seite (Stichwort: Social Media Graph)

Semantisches Web 3.0 (Jedes Jahr auf’s neue, bis es endlich flächen deckend umgesetzt wurde)

Webseiten ohne Flash mit Alternativer Umsetzung mit HTML5 oder Java-Script (Stichwort: Barrierefreie Webseiten)

und noch viele weitere, 1 Internet Jahr kann sehr lang sein, das internet ist schließlich sehr schnelllebig

Sollte Ihre Webseite aus unerklärlichen Gründen stark im Ranking fallen (Position in den Google-Suchergebnisliste) oder gar komplett aus den Index der Suchmaschine verschwinden, so liegt höchst wahrscheinlich ein Google Penalty vor. Und diese sehr wirksamen Strafen gegen Webseiten Betreiber kommen häufiger als einige Webmaster ahnen.

Sollte Ihre Webseite aus unerklärlichen Gründen stark im Ranking fallen (Position in den Google-Suchergebnisliste) oder gar komplett aus den Index der Suchmaschine verschwinden, so liegt höchst wahrscheinlich ein Google Penalty vor. Und diese sehr wirksamen Strafen gegen Webseiten Betreiber kommen häufiger als einige Webmaster ahnen.